你确认删除该任务么?此任务一旦删除不可恢复。

|

|

2 年前 | |

|---|---|---|

| docs | 2 年前 | |

| related_paper | 2 年前 | |

| README.md | 2 年前 | |

| few-shot learning0607.pptx | 2 年前 | |

README.md

P-Tuning for Few-shot

Few-shot learning

小样本学习(few-shot learning):在人类快速学习能力的启发下,研究人员希望机器学习模型在学习了一定类别的大量数据后,对于新的类别,只需要少量的样本就能快速学习,这就是Few-shot Learning要解决的问题。

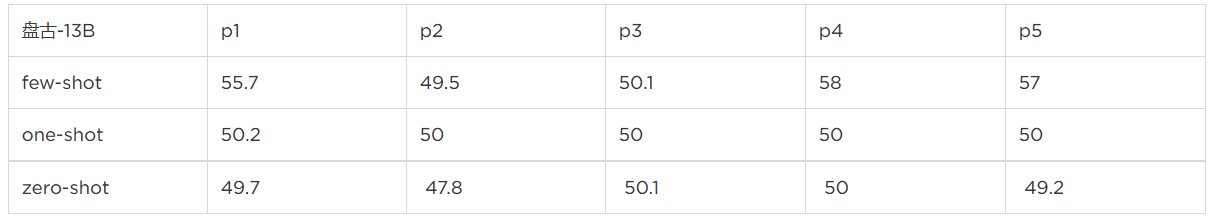

盘古α-13B模型在下游任务CSL(论文关键词识别)不同prompt下zero-shot 、one-shot、few-shot下的精度对比

举例:摘要:以历史文字、图像和口述史资料的分析为切入点,从渊源和修复两个方面,扼要探讨了桑珠孜宗堡的变迁真相及复原再现的特殊意义.

关键词:"口述史,桑珠孜宗堡,修复"

label: "是"

P1: "摘要:"+text+",关键词:"+keyword+label+"真实关键词\n\n"

其中label_map = {"0": "不是", "1": "是"}

P2: "摘要:" + text + ",关键词:" + keyword +label+"摘要提取的关键词\n\n"

label_map = {"0": "不是", "1": "是"}

P3: “提取的关键词对吗?”+label+"正确。"+“摘要:”+text+“关键词:”+keyword +"\n\n"

label_map = {"0": "不", "1": "很"}

P4: "摘要:"+text +",关键词:"+keyword +",这是"+label + "准确的\n\n"

label_map = {"0": "不", "1": "狠"}

P5: "摘要:"+text+",关键词:"+keyword+label+"准确的关键词\n\n"

其中label_map = {"0": "不是", "1": "是"}

少样本学习算法总结与实验

PPT包含以下几个部分:

(1)论文《True Few-Shot Learning with Language Models》概述,给以后的少样本学习指明了方向,用实验验证了模型选择的困难。

(2)智源大会分享的FewNLU小样本框架:主要包括规范了少样本学习的评测方法和一整套实验的框架,减少overfitting带来的不真实的结果,使得评测是科学的,有意义的。提出了基于相反标签的数据增广方法提升性能,最终在3个比较难的自然语言处理任务上取得和full label相近的效果。

(3)包括PET、ptuing、ADAPET、EFL等目前主流的少样本算法以及在GPU上(CSL任务)的实验结果